ETL(抽出、変換、ロード)

概要と重要性

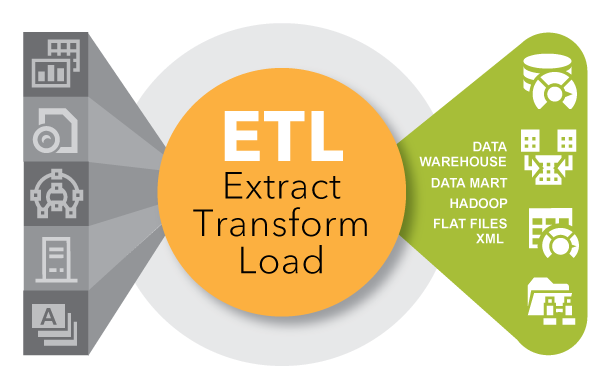

ETLとはデータ統合手法の一種であり、複数のソースからデータを取り込んで融合するために使われる3つのステップ(extract=抽出、transform=変換、load=ロード)のことを指しています。ETLはデータウェアハウスを構築する際に広く利用されています。このプロセスでは、ソースシステムからデータを取り込み(抽出)、分析可能なフォーマットに整形し直し(変換)、データウェアハウスやその他のシステムに保管します(ロード)。これに関連した手法としてELT(抽出、ロード、変換)がありますが、ELTは変換処理をデータベースに任せてパフォーマンスを改善するために設計された手法です。

ETLの歴史

ETLが広く利用されるようになったのは、企業や組織が異なるタイプのビジネス情報を保管し分けるために複数のデータ・レポジトリ(=データベース)を使い始めた1970年代です。複数のデータベースに分散して保管されたデータを統合する必要性が急速に高まった結果、異種混在のソースからデータを取り込み、何らかの変換を施してから目的の場所にロードするプロセスの標準的な手法として、ETLが定着したのです。

その後、1980年代後半から1990年代前半にかけて、データウェアハウスが台頭しました。データベースの特殊な利用形態であるデータウェアハウスの本来の役割は、メインフレーム・コンピューター、ミニコンピューター、パーソナル・コンピューター、スプレッドシートなど、複数のシステムに由来するデータに対する統合アクセスを提供することです。しかし実際には、さまざまな部門が異なるデータウェアハウスを導入し、異なるETLツールを利用するケースが続出しました。そうした状況に産業界のM&A(合併・買収)の流れが加わったことで、複数のETLソリューションを未統合のままで併用する組織が増えていきました。

また、時代とともに、データのフォーマット、ソース、システムの種類は膨大な数に膨れ上がってきました。現在では、ETLはデータを収集、インポート、処理するために使われる数多くの手法の1つにすぎませんが、ETLとELTが企業や組織におけるデータ統合戦略の重要な要素である点は変わっていません。

ETLが重要な理由

ビジネスの世界では長年にわたり、意思決定の的確化を推進する「データの統合ビュー」を確立する作業をETLプロセスに依存してきました。ETLは現在でも、複数のシステムやソースに由来するデータを統合するための代表的な手法として、データ統合ソリューションの中核コンポーネントに位置付けられています。

ETLは、多種多様なソースからデータを移動および変換し、Hadoopなどのさまざまなターゲットにロードするために使われます。

- ETLは、エンタープライズ・データウェアハウス(蓄積されたデータ)からビジネスに関する詳細な履歴情報やコンテキスト情報を引き出して活用するために必要不可欠な機能です。

- ETLで統合ビューを確立することにより、ビジネスユーザーが目的に合ったデータにアクセスし、分析やレポート作成を実行するプロセスが容易になります。

- 今日のETLツールは、コードやスクリプトを書くITスキルを必要としないデータ移動プロセスを体系化して再利用するため、データ担当者の生産性向上に寄与します。

- ETLツールは進化を続けており、現在ではストリーミング・データのような最先端の統合要件もサポートしています。

- データウェアハウスの運用、レポートの作成、アナリティクスの実行などに欠かせない基盤機能(データの収集・統合、品質の維持、ガバナンスや監査)を実現するためには、ETLとELTの両方が必要です。

今日の世界におけるETL

現在、データ活用の最先端領域といえるストリーミング・アナリティクスでは、高速に移動するデータ(ストリーミング・データ)をその場で捕捉・分析できるようになっています。このアプローチでは、その瞬間に何が起きているかをほぼリアルタイムで把握し、それを踏まえて即座に行動することが可能になります。それに対し、ETLによって確立される履歴ビューでは、データをコンテキストの中で把握することができます。このアプローチでは、時系列に沿って幅広い視野から、ビジネスの動きを包括的に捉えることが可能になります。小売システムにおけるリアルタイム・レコメンデーションや、設備資産の予知保全といった最先端のアナリティクス活用を実現するためには、これら2つのアプローチを連携させる必要があります。

データ統合のモダナイゼーションに関する7つのヒント

データ統合テクノロジーには何十年もの歴史がありますが、現在でもなお、データを収集/処理/移動するプロセスにおいて重要な役割を担っています。このTDWI社のレポートに示されたヒントは、データ統合機能を最新化する取り組みのガイドとして役立ちます。

単一の顧客ビューがもたらすメリット

このエネルギー企業では、需要家データをさまざまなシステムに、さまざまなフォーマットで蓄積していました。SAS® Data Managementソフトウェアを導入してレコードのクレンジングと統合を行ったところ、需要家レコードの総件数は25%減り、各レコード内の情報の完全性は30%向上しました。

データ統合の再考

古いテクノロジーの中には、絶滅を免れ、新しいテクノロジーと共存していくものも少なくありません。データ統合はその好例であり、さまざまなソース、フォーマット、テクノロジーの進化に後れをとらないように常に変わり続けています。このホワイトペーパーでは、企業や組織おけるデータ統合アプローチの陳腐化を回避する方法を説明しています。

SAS、2016年版Gartner Magic Quadrantでリーダーと評価

ガートナー社は「2016年版データ統合ツールに関するマジック・クアドラント」(英語版) で、SASをリーダーと位置付けています。

最大の成功を収めることになるのは、データ統合は競合他社との差別化の根本的な土台であるという認識のもとで、明快かつ的確な戦略を策定する組織でしょう。

– デイビッド・ローシン(David Loshin)氏、Knowledge Integrity社、社長、The New Data Integration Landscape: Moving Beyond Ad Hoc ETL to an Enterprise Data Integration Strategy(新たなデータ統合環境:アドホックETLから全社的データ統合戦略への移行)より

SASのデータ統合ソフトウェア

SASのデータ統合ソフトウェアは、統合タスクを任意のプラットフォームに分散できる機能と、あらゆるソースやターゲット・データストアに接続できる機能を完備しています。

ETLの主な活用方法

中核的な機能を提供するETL/ELTツールは、他のデータ統合ツールや、データ管理のその他の側面(データ品質、データ・ガバナンス、仮想化、メタデータなど)と連携して機能します。今日の一般的な用途としては、例えば以下のようなものがあります。

ETLの従来の用途

ETLは導入効果が実証済みの手法であり、多くの企業・組織の日常業務を支えています。例えば、小売企業で販売データを定期的に確認するプロセスや、医療機関で医療費請求を正確に処理するためのプロセスにはETL機能が不可欠です。ETLを利用すると、ビジネスユーザーが理解できるフォーマットでデータを提示するための準備作業として、データウェアハウスや他のデータストアからトランザクション・データを抽出して組み合わせ、必要な変換・加工を行うことができます。ETLは、レガシーシステムのデータを、別のフォーマットを採用している最新システムに移行する目的でも使われます。また、事業合併後にデータを整理統合する目的や、外部サプライヤー/パートナーのデータを収集・結合する目的で使われることもあります。

ETLとビッグデータ – 変換とアダプタ

最も多くのデータを手にした者が勝者となるとは限りませんが、幅広いデータに容易にアクセスできるIT環境が企業に競争優位性をもたらす可能性が高いのは事実です。今日の企業には、ビデオ、ソーシャルメディア、モノのインターネット(IoT)、サーバーログ、地理空間データ、オープンデータ、クラウドソーシング・データなど、あらゆる種類のビッグデータを有効活用することが求められています。ETLベンダーは、こうした最新の要件や新種のデータソースをサポートするために、自社のツールに頻繁に新しい変換機能を追加しています。アダプタとは、多種多様なデータソースへのアクセスを可能にするアドオン的なソフトウェア機能であり、データ統合ツールでは、データの抽出とロードを効率的に実行するために各種のアダプタを利用します。

Hadoopや他のシステム向けのETL

今日のETL機能は、従来のデータウェアハウスとは比較にならないほど多種多様な統合をサポートするように進化しています。高度なETLツールは、構造化データと非構造化データをHadoopにロードして変換することができます。こうしたツールは、Hadoopとの間で複数のファイルを並列実行で読み書きするため、さまざまなデータを共通の変換プロセスにかける方法が簡素化します。Hadoop上で実行されるトランザクション・データとインタラクション・データの両方を対象として、プリセットのETL変換ライブラリを搭載しているソリューションもあります。ETLは、トランザクション・システム、オペレーショナル・データストア(ODS)、BIプラットフォーム、マスターデータ管理(MDM)ハブ、クラウドなどを横断した統合もサポートします。

ETLとセルフサービス方式のデータアクセス

セルフサービス方式のデータ準備機能は急速に広がっているトレンドであり、適切な環境を整備すれば、データのアクセスから統合、変換までの作業をビジネスユーザーや技術に詳しくないデータ担当者に委ねることができます。このアプローチでは、アドホックな(非定型の)作業を簡単かつ迅速に行えるため、組織全体の俊敏性が向上し、IT部門はビジネスユーザー向けに多様なフォーマットでデータを用意する負担から解放されます。そして、データの準備にかかる時間が減るほど、洞察を導き出す作業に充当できる時間が増えることは言うまでもありません。この環境では、業務部門とIT部門の双方で生産性が向上することから、組織を挙げてデータ活用の規模を拡大し、より幅広い領域で意思決定の強化を追求できるようになります。

ETLとデータ品質

ETL機能は、その他のデータ統合機能(クレンジング、プロファイリング、監査)を提供するソフトウェア・ツールと連携して、データの信頼性を確保します。ETLツールはデータ品質ツールと統合されていることが多く、また、ETLベンダーはデータ・マッピングやデータ・リネージなどの関連ツールも自社のソリューションに組み込んでいます。

ETLとメタデータ

メタデータは、データ・リネージ(どこから生じたかを示す系統情報)を調べたり、特定のデータが組織内の他のデータ資産に及ぼす影響を理解したりするために役立ちます。昨今は、データ・アーキテクチャの複雑化に伴い、組織内のさまざまなデータ要素がどのように利用され、関連し合っているかを追跡管理することの重要が高まっています。例えば、Twitterのアカウント名を顧客データベースに追加する場合には、その影響が及ぶ対象(例:ETLジョブ、アプリケーション、レポート)を把握する必要があります。

仕組み

ETL機能は、その他のデータ統合機能/プロセス/手法と密接に関連しています。これらを理解すれば、ETL機能の仕組みをより明確に把握することができます。

| SQL | SQL(Structured Query Language)は、データベース内のデータにアクセスして変換を実行するために利用できる最も一般的な手法です。 |

| 変換、ビジネスルール、アダプタ | ETLはデータの抽出後、ビジネスルールを用いてデータを新しいフォーマットに変換します。その後、変換済みのデータをターゲットにロードします。 |

| データ・マッピング | データ・マッピングは変換プロセスの一部です。マッピング機能はアプリケーションに対し、処理する必要のあるデータの取得方法ついて詳細な命令を提供します。また、ソースフィールドと宛先フィールドの対応関係も記述します。例えば、Webサイトのアクティビティに関するデータフィードにおいて、3番目の属性がユーザー名で、4番目はアクティビティ発生日時のタイムスタンプ、5番目はユーザーがクリックした製品であるとします。このデータを使用するアプリケーションまたはETLプロセスは、これらのフィールド(属性)をソースシステム(Webサイトのアクティビティのデータフィード)から、宛先システムの適切なフィールドとそのフォーマットにマッピングしなければなりません。仮に宛先システムが顧客関係管理システムだとすると、ユーザー名を例えば1番目のフィールドに保管し、タイムスタンプを5番目のフィールドとして保管する一方で、クリックされた製品の情報の保管は不要かもしれません。また、このケースでは、日時データを適切なフォーマット(および適切な順序)に変換する処理が、データをソースから読み込む処理とターゲットに書き込む処理の間のどこかのタイミングで実行されることになるでしょう。 |

| スクリプト | ETLツールは、データを移動および変換するための各種スクリプト(命令のセット)の実行を自動化する手法によって実現されています。ETLツールが登場する以前は、プログラム言語のCまたはCOBOLを用いて、特定のシステム間でデータを転送するスクリプトを個別に記述していました。そのため、当時は複数のデータベースを対象として膨大な数のスクリプトが実行されていました。初期のETLツールはメインフレーム上でバッチプロセスとして実行されましたが、その後、UNIXやPCなどのプラットフォームに移植されました。企業や組織は今でも、データ移動手法としてスクリプトとプログラミングの両方を利用しています。 |

| ETLとELT | 最初のうちはETLだけが利用されていましたが、やがて補完的な手法としてELTも併用されるようになしました。ELTはソースシステムからデータを抽出し、宛先システムにロードしてから、宛先システムの処理能力を用いて変換を実行します。この手法では、データの利用場所でデータ処理が発生するため、今日の一般的なアナリティクス環境では高速化が実現します。 |

| データ品質 | 多くのデータ統合プロセスでは、統合を実行する前にステージング(中間準備)領域が作成されます。この領域では、データのクレンジング、データ値の標準化(NCとNorth Carolina、MisterとMr.、MattとMatthewのような表記のバラツキの統一)、住所の検証、重複の排除などを実行できます。多くのデータ品質ソリューションは今もスタンドアロン型ですが、現在ではデータ統合プロセスの変換処理の1つとしてデータ品質プロシジャを実行できるソリューションもあります。 |

| スケジューリングと処理 | ETLのツールやテクノロジーは、バッチ・スケジューリング機能またはリアルタイム機能、あるいはその両方を提供します。また、データ変換処理はETLツールの実行元のサーバー上で実行することも、あるいはデータベースにプッシュダウンして実行させることもできます。後者の方法では、サーバー上の専用エンジンではなくデータベース内で処理を実行でき、変換のため(だけ)にデータを複製する必要がなるくなるため、データ管理プラットフォーム全体で用意すべき容量の要件が低減します。 |

| バッチ処理 | ETLという用語は、多くの場合、所定の時間(=バッチ・ウィンドウ)内に2つのシステム間で大量の情報を移動するバッチプロセスを指します。この期間中(例えば正午から午後1時までの間)はデータの同期を維持する必要があるため、ソースシステムと宛先システムのいずれでもアクションを一切実行できません。ほとんどの銀行では、日中に発生したトランザクションを解決するために、夜間にバッチプロセスを実行しています。 |

| Webサービス | Webサービスとは、データまたは機能を幅広いアプリケーションにニア・リアルタイムで提供することができるインターネット・ベースの手法です。この手法ではデータ統合プロセスが簡素化され、データからより多くの価値をより短時間に引き出すことができます。例えば、顧客が企業のコールセンターに電話をかけてくるとしましょう。適切なWebサービスを作成すると、顧客の電話番号をそのサービスに渡すだけで、複数のソースやMDMハブからデータを抽出して完全な顧客プロファイルを1秒未満の応答時間で取得して表示するようなWebアプリケーションを実現できます。こうしたシステムを通じて豊富な顧客情報をその場で参照できれば、顧客サービス担当者は、それぞれの顧客にどのように対応すべきかについて、より的確な意思決定を行えるようになります。 |

| マスターデータ管理(MDM) | MDMとは、複数のソースを横断してデータの定義を統一し、整合性を維持するプロセスです。MDMの導入段階では、ETL機能と、データを整理統合して「ゴールデン・レコード」または「ベスト・レコード」を作成するためのデータ統合機能の両方が重要な役割を果たします。 |

| データ仮想化 | データ仮想化とは、仮想ビューを用いて、データを移動することなしに、データを抽出・統合した結果だけを示す手法です。データ仮想化がETLと異なるのは、データのマッピングや結合は行うものの、抽出や統合の結果を保管する物理的なスペースを必要としない点です。仮想ビューは多くの場合、パフォーマンス向上の目的でメモリ内にキャッシングされるため、俊敏性も向上します。SAS Federation Serverのような一部のデータ仮想化ソリューションは、役割別やグループ別の機密データ保護を実現するために利用できるダイナミック・データ・マスキング、ランダム化、ハッシングなどの機能を備えています。SASでは、ビューの生成時に作動するオンデマンド型のデータ品質機能も提供しています。 |

| イベント・ストリーム・プロセッシングとETL | 1秒に数百万件のイベント/データが発生するような状況、つまりストリーミング・データの分析には、イベント・ストリーム・プロセッシング手法が適しています。このテクノロジーでは、ストリーミング・データをモニタリングおよび捕捉して即座に分析できるため、よりタイムリーな意思決定支援を実現することが可能です。エネルギー業界では、圧力センサーなどのデータ・ストリームに予測分析を適用し、水中ポンプの修理が必要になる時期を予見することにより、計画外の稼働停止時間を削減するとともに、ポンプの損傷の範囲と程度の抑制に成功している事例があります。 |

このトピックに関する他のインサイト

- データレイクの概念と重要性データレイク(データの湖)とは、大量の生データをネイティブのフォーマットのままで素早く取り込む保管庫です。複数のデータ・コレクションを1ヶ所の便利な場所に格納できるデータレイクにより、セルフサービス型のアクセス、探索、ビジュアライゼーションの実現が容易になります。その結果、企業は新しい情報の把握と対応措置をより迅速に実行できるようになります。

- 適切なデータ処理を支える5つのデータ管理ベストプラクティスデータ管理に関するこれら5つのベストプラクティスに従えば、ビジネスデータは確実に素晴らしいアナリティクス成果をもたらすようになります。

- 持続可能なGDPRコンプライアンス体制の実現に向けた5つのステップ本稿で説明するステップに従えば、2018年5月の発効日までにGDPRコンプライアンスを達成した上で、追加のメリットも実現することができます。

- 一般データ保護規則 (GDPR):重荷からチャンスへ一般データ保護規則 (GDPR) に関係者は複雑な感情を抱いていますが、この新しい規則への取り組みをビジネス上の優位性に結びつける方法を、カリオピ・スピリダキ(Kalliopi Spyridaki)がご説明します。